Foto editada por IA de Alex Pretti foi exibida por grandes veículos — como a imagem alterada circulou e alimentou desinformação sobre a morte em Minneapolis

MS NOW, Daily Mail e outros publicaram uma versão melhorada por inteligência artificial de um retrato oficial; a alteração amplia problemas de verificação e confiança em fotos online

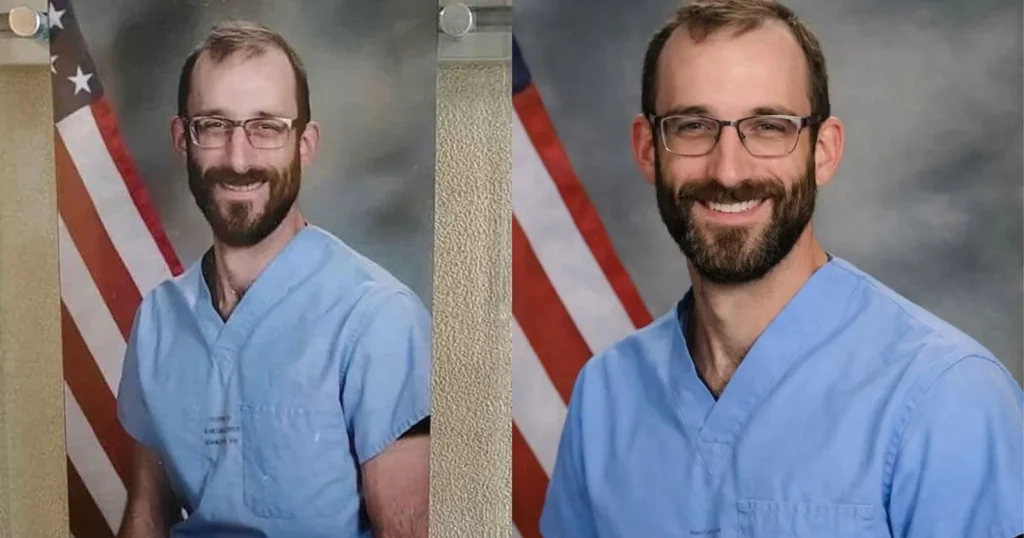

Uma foto de Alex Pretti, o manifestante que morreu após ser baleado por agentes de fronteira em Minneapolis, foi exibida por canais de grande alcance em versão editada por inteligência artificial (IA). A emissora a cabo MS NOW — anteriormente conhecida como MSNBC — usou a imagem em sua cobertura, e a mesma versão também apareceu em veículos como Daily Mail e International Business Times.

Origem da imagem e o que foi alterado

O ponto de partida foi um retrato oficial do Departamento de Assuntos de Veteranos dos Estados Unidos, onde Pretti trabalhava como enfermeiro de unidade de terapia intensiva. Esse retrato era, na prática, uma foto de uma foto, com baixa resolução. Alguém na internet submeteu essa imagem a um modelo generativo de IA para “melhorar” a qualidade.

A versão resultante amplia os ombros, bronzeia a pele e suaviza traços do nariz, deixando Pretti com aparência mais atraente — mudança que gerou críticas, inclusive do podcaster Joe Rogan, sobre como a emissora teria feito o manifestante “parecer mais bonito”. MS NOW disse ao site Snopes que não fez a edição e que tomou a imagem da internet sem perceber que havia sido alterada.

Como a IA transforma imagens e por que isso é um problema

Ao alimentar um modelo generativo com uma foto de baixa qualidade e instruções para “melhorar”, o sistema não simplesmente limpa pixels: ele cria uma nova imagem influenciada tanto pela foto quanto por padrões aprendidos em seu treinamento. O resultado pode se aproximar do original, mas deixa de ser uma representação fiel da realidade. Além disso, esses modelos tendem a introduzir vieses estéticos, tornando rostos mais simétricos ou atraentes.

Ferramentas citadas em reportagens incluem desde modelos experimentais até soluções de upscaling que usam aprendizado de máquina; independentemente da tecnologia, o efeito prático é o mesmo: uma imagem viral pode ser tecnicamente nova e enganosa.

Impacto na cobertura e responsabilidade jornalística

Além do retrato de Pretti, outras imagens virais relacionadas ao caso foram identificadas como geradas ou manipuladas por IA — uma delas, que alegava mostrar o momento do disparo, não coincide com múltiplos vídeos do incidente, segundo a Reuters. A Casa Branca também publicou uma foto manipulada de uma manifestante, alterando expressões faciais.

Especialistas e verificadores pedem mais checagem por parte das redações e plataformas antes de republicar imagens encontradas online. MS NOW não respondeu ao pedido de esclarecimento da PetaPixel sobre a circulação da foto alterada.

O episódio reforça que melhoria automática de imagens pode espalhar desinformação mesmo sem intenção explícita: é preciso verificar origem e integridade de fotos, sinalizar manipulações e educar o público sobre os limites das imagens “restauradas” por IA.

Carlos Rincon – Professor de Fotografia e Pesquisador – Campinas | 1983Em meus trabalhos busco construir uma imagem utilizando um processos históricos da fotografia. A construção da imagem consiste no estudo fundamental no comportamento do ser humano na sociedade e na natureza que o circunda, tendo os princípios da sociologia e filosofia no comportamento humano e sociedade, base fundamental nas minhas pesquisas e fotografia. Há 22 anos sendo professor de fotografia, consigo obter um olhar e um processo criativo ainda mais apurado no âmbito da arte fotográfica devido a diversidade de temas que abordo diariamente.